يوضح البروفيسور توبي والش، مدير مجموعة الأبحاث في جامعة نيو ساوث ويلز: "يمكن لمبرمج واحد أن يسيطر على جيش بأكمله". "جميع أسلحة الدمار الشامل محظورة بالفعل في مرحلة التطوير أو في عملية الحظر - الأسلحة الذرية والكيميائية والبيولوجية. يجب أن نضيف الأسلحة المستقلة إلى هذه القائمة، وهو ما لا يمكننا قبوله أخلاقيا".

وقع باحثون بارزون في مجال الروبوتات والذكاء الاصطناعي من دولتين بارزتين في الكومنولث البريطاني - كندا وأستراليا، مؤخرًا على رسائل مفتوحة تدعو رؤساء الحكومات إلى اتخاذ موقف ضد تحويل الذكاء الاصطناعي إلى سلاح.

وفي مقابلة مع موقع هيدان، يوضح البروفيسور توبي والش، مدير مجموعة بحثية في جامعة نيو ساوث ويلز، أن الرسالة تم إعدادها تحضيراً لمؤتمر الأمم المتحدة لنزع السلاح الذي عقد في جنيف في نوفمبر 2017.

وحتى الآن، وقعت 19 دولة على حظر تطوير الأسلحة المستقلة؛ الجزائر، الأرجنتين، بوليفيا، تشيلي، كوستاريكا، كوبا، الإكوادور، مصر، غانا، غواتيمالا، الفاتيكان، المكسيك، نيكاراغوا، باكستان، بنما، بيرو، فنزويلا، زيمبابوي والسلطة الفلسطينية.

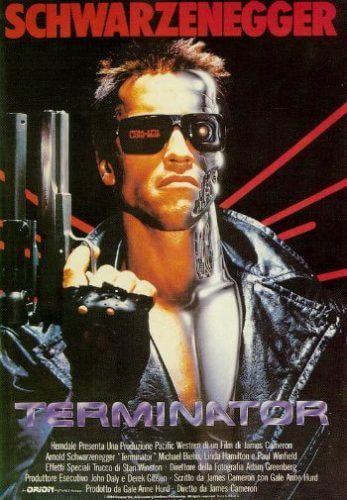

وتوصف الأسلحة المستقلة أيضًا بالروبوتات القاتلة، لتحرق وصفًا ثالثًا في أذهان معظم البشر. يوضح البروفيسور والش: "نحن لا نتحدث عن مبيد حشري على الطراز السينمائي لفيلم Terminator، ولكن عن تقنيات أبسط بكثير يمكن تنفيذها في غضون بضع سنوات. على سبيل المثال، طائرة بدون طيار مفترسة ستحلق فوق سماء العراق بدون توجيه بشري عن بعد ولكن بواسطة الكمبيوتر. والآن، في الواقع، سيكون الكمبيوتر قادرًا على اتخاذ القرار النهائي بشأن الحياة أو الموت – سواء بإطلاق الصاروخ أم لا".

ووفقا له، "أنا لا أخاف من الذكاء الاصطناعي الذكي، بل من الذكاء الاصطناعي الغبي". سنمنح الآلات الحق في اتخاذ قرارات الحياة والموت، لكن التكنولوجيا الحالية غير قادرة على اتخاذ القرارات الصحيحة".

"على المدى الطويل، ستكتسب الأسلحة المستقلة قدرات أكبر - لكنني أشعر بالقلق من أن يقوم شخص ما بتحويلها إلى أسلحة من شأنها تقويض النظام الجيوسياسي، وتصبح في النهاية نوعًا آخر من أسلحة الدمار الشامل. وتم توزيع الرسالة الأسترالية بالتزامن مع الرسالة الكندية الموجهة إلى رئيس الوزراء جاستن ترودو، والتي وقعها اثنان من مؤسسي مجال التعلم العميق والذكاء الاصطناعي - جيفري هينتون وجوشوا بنجيو.

الثورة العسكرية الثالثة

وقال والش: "لقد قمت بتنظيم الرسالة الأسترالية التي وقعها 122 عالما، بينهم العشرات من العمداء ورؤساء أقسام الجامعة، بالإضافة إلى أساتذة الذكاء الاصطناعي والروبوتات".

في الرسائل، كتب الباحثون أن السلاح القاتل المستقل الذي يفتقر إلى السيطرة البشرية هو على الجانب الخطأ من الأخلاق. ووفقاً للبروفيسور والش، فقد ناشدوا رؤساء دولهم الالتزام بالعمل مع الدول الأخرى لإدراج الأسلحة المستقلة كأحد التطورات المحظورة، على غرار الأسلحة البيولوجية والأسلحة الكيميائية.

ويقول إن "الأمم المتحدة تستمع إلى هذه الأصوات التي تسمع منذ عدة سنوات، وهي تستجيب". ولكن مثل كل شيء في الدبلوماسية، فإن التنمية ليست سريعة."

في ديسمبر/كانون الأول 2016، بعد ثلاث سنوات من المحادثات غير الرسمية، بدأت الأمم المتحدة سلسلة من المحادثات الرسمية ضمن مجموعة من الخبراء الحكوميين ضمت خبراء تكنولوجيين وقانونيين وسياسيين اختارتهم الدول الأعضاء للتوصية باتخاذ إجراءات، ولكن ليس للتفاوض بشأن الأسلحة المستقلة غير المأهولة. اتفاق الانتشار

ويقول البروفيسور والش إن الخطر في عدم وجود مثل هذا الاتفاق هو أن سباق التسلح سوف يتطور لتطوير المزيد والمزيد من الأسلحة المستقلة القوية. وستكون هذه ثورة عسكرية ثالثة - بعد اختراع البارود وتطوير القنبلة الذرية. وستكون هذه الثورة الثالثة خطوة أخرى في السرعة والكفاءة التي يمكن أن يقتل بها هذا السلاح".

ويوضح قائلاً: "يمكن لمبرمج واحد أن يسيطر على جيش بأكمله". "جميع أسلحة الدمار الشامل محظورة بالفعل في مرحلة التطوير أو في عملية الحظر - الأسلحة الذرية والكيميائية والبيولوجية. يجب أن نضيف الأسلحة المستقلة إلى هذه القائمة، وهو ما لا يمكننا قبوله أخلاقيا".

البروفيسور توبي والش، مدير مجموعة الأبحاث في جامعة نيو ساوث ويلز، جامعة نيو ساوث ويلز. الصورة: العلاقات العامة

من يطور مثل هذا السلاح؟

الولايات المتحدة والصين وروسيا وبريطانيا العظمى ودول متقدمة أخرى، بما في ذلك إسرائيل.

"المادة الخام" لقنبلة الذكاء الاصطناعي هي الأشخاص الموهوبون. هل يمكن للمنظمات الإرهابية أن تدفع لهم مقابل تطوير مثل هذا السلاح؟ كيف يمكننا تدقيق هذا؟

"إن طريقة انتقاد هذه الأسلحة هي نفس الطريقة التي ننتقد بها التقنيات الأخرى مثل الأسلحة الكيميائية والأسلحة البيولوجية. ولم نتمكن من التوقف عن الترويج للكيمياء، لكننا جعلنا استخدام الأسلحة الكيميائية غير مقبول أخلاقيا، ومنع مصنعو الأسلحة من بيعها. وبهذه الطريقة فهي ليست للبيع ولا متاحة في السوق السوداء، وبالتالي فإن استخدامها محدود للغاية. يمكننا أن نأمل أن يحدث الشيء نفسه مع السلاح المستقل أيضًا."

"لا يمكننا وقف تطور الذكاء الاصطناعي. ويمكن استخدامها في العديد من الأغراض السلمية مثل السيارات ذاتية القيادة، ولكن يمكننا أن نجعل استخدامها للقتل أمرًا غير أخلاقي وغير مقبول، كما فعلنا مع الأسلحة الكيميائية والبيولوجية. وآمل بهذه الطريقة أن نجعل العالم أكثر أمانا".

وماذا تعرف عما يحدث في إسرائيل في هذا المجال؟

"لن تكون إسرائيل آمنة إذا وجدت أسلحة ذاتية التشغيل. سيكون عليهم الدفاع عن أنفسهم ضد هذا السلاح الرهيب".

تم نشر المقال على موقع People and Computers كجزء من قسم أسبوعي يتناول الذكاء الاصطناعي.

تعليقات 14

منافس، الرابع

هناك العديد من الأسلحة المحظورة استخدامها، ومن يخالف هذه القوانين يمكن أن يجد نفسه في ورطة خطيرة، لذلك فإن القوانين لها معنى.

من ناحية أخرى - كانت الأسلحة المستقلة موجودة دائمًا منذ العصور القديمة. ألا نفضل الألغام التي تحيد نفسها في نهاية الحرب؟ أو صواريخ الطائرات التي ستعرف عدم إسقاط مثل هذه الطائرات الصديقة (وكان هذا موجودًا منذ فترة طويلة).

مثل هذه الرسائل مهمة لطرح المشاكل. هل من الأفضل تجاهل المخاطر؟ ينبغي أن يكون مفهوما أن "الذكاء الاصطناعي" ليس له تعريف، لذلك ليس له معنى عملي كبير.

يتمتع كل نظام تشغيل اليوم بذكاء اصطناعي، وكل هاتف وكل سيارة.

مجهول

تم اختراع الأسلحة الذرية في الولايات المتحدة لأنهم كانوا يخشون أن يخترعها شخص آخر أولاً. إنه سلاح هجومي مصمم لإحداث أقصى قدر من الضرر، سواء للممتلكات أو للحياة البشرية.

ولا يوجد دليل على أن الردع النووي ينقذ الأرواح. ومن ادعى غير ذلك فليثبته.

وهذه وثيقة لا قيمة لها ولا صلة لها بالواقع. يعد الذكاء الاصطناعي عاملاً مضاعفًا هائلاً للقوة بحيث لا يرغب أي جيش أو قائد جيش في التخلي عنه في ساحة المعركة الحديثة. يوجد اليوم بالفعل عدد لا بأس به من عناصر الذكاء الاصطناعي في ساحة المعركة، على سبيل المثال صاروخ هاجيل الإسرائيلي (من عائلة سبايك) يستخدم الذكاء الاصطناعي لضرب الأهداف في ظروف الرؤية الصعبة وعندما يحاول الهدف الاختباء أو التهرب، فإن F -35 طائرة وصلتنا تتمتع بقدر لا بأس به من الذكاء الاصطناعي الذي بدونه الطائرة لا قيمة لها.

من سيكون على استعداد للتخلي عن كل شيء؟

122 عالما وقعوا وثيقة...

وحتى لو وقع 122,000 ألف عالم على هذه الوثيقة، فلن يتغير شيء. سيتم استخدام عمل هؤلاء العلماء أنفسهم لبناء أسلحة الدمار الشامل أو أي خطة أخرى حقيرة وغبية، لأن صناع القرار سيكونون دائمًا أشخاصًا جشعين وقصيري النظر. (أمثال يوتام، كتاب القضاة، الفصل XNUMX)

ومن الواضح تماماً أن الفلسطينيين ليس لديهم مشكلة في معارضة الأسلحة النووية.

بعد كل شيء، ليس لديهم.

لكن دولة إسرائيل لديها، وقد فعلت ذلك. وأيضا إلى الولايات المتحدة الأمريكية.

وبشكل عام ،

لا مشكلة مع الأسلحة النووية.

حيث لا توجد مشكلة مع السيارة.

وكما لا توجد مشكلة بالسكين.

تم اختراع السلاح الذري لحماية الحلفاء، من بؤس الحياة (يومها هتلر يهدم اسمه واليوم مع أبو أدولف مازن يهدم بيته عليه وعلى عائلته)

المشكلة هي عندما تقع هذه الأشياء في أيدي النفوس البائسة. مثل الفلسطينيين وبقية الإرهابيين في العالم.

عندي مشكلة مع هذا المقال...

ويبدو أنه مع مرور الوقت، فإن القتل الجماعي العشوائي لا ينتمي إلى العالم الذي نعيش فيه.

الإنسان اليوم هو موضوع الاحتلال.

المهنة مالية بشكل رئيسي.

وبما أن هذا هو الحال - فإن القضاء على شخص ما يشبه تحرير الأرض (التي تم القتال من أجلها قبل سنوات)

يجب على الإنسان اليوم - طوال حياته أن يستخدم الخدمات التي تقدمها الشركات (سواء كانت الطب أو التمريض أو التكنولوجيا وغيرها). وبما أن هذا هو الحال فإن الشخص الميت لا يساوي شيئًا تقريبًا.

ويترتب على ذلك أنه مع مرور الوقت، سيعيش الناس لفترة أطول (سيعيش الأطفال الذين يبلغون من العمر 5 سنوات اليوم أكثر من 100 عام بلا شك) وستصبح قدرات الشركات أقوى.

والسؤال الذي يطرح نفسه: ما هو دور التنظيم (السلطة التشريعية) في هذه المعادلة برمتها؟

يجب أن تبدو هذه وكأنها تواجه مواطنًا

ولكن من الناحية العملية (ونعم، يجب أن يكون هناك تركيز على ع.) فإن هذه تخدم الشركات.

ويمكن تسمية هذه القصة بأكملها بـ ML-3 (الحرب العالمية الثالثة).

----

مشكلة هذه الحرب هي أننا لا نعرف كيف نتعرف على الحرب إلا عندما تكون هناك دبابات وطائرات ومدمرات أخرى، وفي الحرب التي أتحدث عنها لا مكان لها.

إن قتل إنسان هو حرق مال - والمال هو الشيء الذي تقوم الحرب من أجله.

----

{ربما أتحدث هراء... لكن هذا ما أشعر به. قد يكون هذا القسم بأكمله من الاغتيالات مرتبطًا بالمنظمات الإرهابية، لكنه لم يعد مرتبطًا حقًا بالعالم الذي نعيش فيه}

لقد أدرك أسيموف بالفعل منذ أكثر من ستين عامًا عدم جدوى الحد من التقنيات "الخطيرة" - ففي معظم الأحيان يتم تجاوزها ببساطة والوصول إلى نفس المخارج بطريقة أرخص وأبسط بكثير. شيء لا يستطيع هؤلاء الباحثون فهمه.

لذلك، في غضون 20 عامًا أو نحو ذلك، لن يواجه يوسي أي مشكلة في مطالبة ذكائه الاصطناعي بتنزيل نموذج لطائرة بدون طيار، وطباعته على الطابعة ثلاثية الأبعاد بالمنزل وطلبها بإسقاط أكياس بلاستيكية مملوءة بالماء مباشرة على رأس جاره المزعج ديفيد. الذي شتمه على الواتساب الحي. حاول الآن العثور على ذكاء اصطناعي يمكنه منع مثل هذه الحالات أو الحالات الأكثر خطورة.

عدا عن ذلك فقد رأيت أن السلطة الفلسطينية وقعت على هذه المعاهدة. ولا عجب في ذلك بالنظر إلى حقيقة أنه ليس لديهم مشكلة في تجنيد أشخاص يتمتعون بذكاء طبيعي ليكونوا بمثابة مشغلين مستهلكين لأحزمتهم الناسفة وشاحنات الجحيم.

نوستراداموس

أنت بعيد كل البعد عن أن تكون بيل جيتس.. أنت شخص يفتقر إلى الفهم ويأكل الحقد. بسبب الحمقى أمثالك، أصبح الإسلام العنيف ناجحًا جدًا.

العالم المستنير كله ضدك يا مسكين...

كل هذه القيود لها غرض واحد. للحد من قوة الغرب في محاربة الشيطان الإسلامي الهمجي والغبي الذي لا يستطيع تطوير مثل هذه التقنيات

لا تخلط بين العقل، فأنت يميني مثلي مثل بيل جيتس. مثل السلام الآن يريدون السلام، ومثل اليسار صهيوني ومثل العملية العسكرية التركية تسمى ورقة الزيتون. وهذا بالضبط هو التكتيك اليساري، استخدام كلمات السلام وشن الحرب لإرباك العدو. وقعت بلاد المسلمين على اتفاقيات الحديبة، وهي اتفاقيات كاذبة كما علمهم محمد. في اتفاقيات أوسلو، وعد عرفات بمحاربة الإرهاب، وفي اليوم التالي قام بتسليح الجميع. إنهم يعينون ويؤسسون منظمات إرهابية ليس لديها مشكلة في استخدام أي سلاح ممكن

نوستراداموس

هل أنت محرج الحق مرة أخرى؟ هل لاحظتم أن جزءاً كبيراً من الدول التي وقعت على معاهدة حظر الأسلحة الذاتية التشغيل هي دول إسلامية؟ وقائمة الدول غير الموقعة على معاهدة مكافحة الألغام تشمل إسرائيل والولايات المتحدة؟

الأسلحة المستقلة موجودة منذ مئات السنين. بالفعل في القرن الثالث عشر استخدم الصينيون الألغام. وقبل ألف سنة من غان كانت هناك بالفعل أفخاخ مثل الشباك والحفر المغطاة.

وحتى ذلك الحين، كان سلاحا فظيعا.

وبطبيعة الحال، لأن المسلمين مسموح لهم بجميع أنواع الأسلحة ولا يسمح للغرب بالانتصار، فنحن بحاجة إلى خلق توازن للقوى. لأن المسلمين ضعفاء ومظلومون.. والنقاش اليساري مشوه ومقيت

هناك شيء واحد مؤكد وهو أنه لن يقوم أحد في قائمة الدول الموقعة بتطوير الذكاء الاصطناعي (والسلطة الفلسطينية ليست دولة)،

لكن أبعد من ذلك، أشك في وجود آلية يمكن بناؤها وإيقافها لأنه لا يوجد انتقال رقمي من 0 ذكاء اصطناعي إلى 1 ذكاء اصطناعي كما هو الحال في تطوير الأسلحة النووية حيث إما يوجد سلاح أو لا يوجد. بالإضافة إلى ذلك، نرى ما هي قيمة القدرة على التحكم في تطوير الأسلحة النووية، في الذكاء الاصطناعي، يعتبر التحول أكثر من مجرد نظير تنموي بدون حدود واضحة، وهو أمر سيكون من الصعب جدًا الإشراف عليه، فكيف يمكن تصنيف النظام على أنه كل ذلك، هل تجاوزت العتبة أم لا

أو لديه القدرة على تجاوز العتبة،

على سبيل المثال، يمكن أيضًا استخدام النظام الدفاعي كنظام هجومي،

على سبيل المثال، هل سيتم حظر حظر نظام الذكاء الاصطناعي القادر على الحماية من وابل الصواريخ غير التقليدية، وبالتالي سوف يموت مئات الآلاف من الناس لإرضاء إحساس الخبراء بالعدالة والأخلاق؟ فمن الواضح أنه لن يتم بناء مثل هذه الأنظمة على نطاق واسع

ولديهم أيضًا إسقاط هجومي مدمج بداخلهم والذي قد لا يتم تفعيله في صراع منخفض الحدة، ولكن بالتأكيد في صراع

سيتم تفعيل الجنرال، عدا عن أن أي شخص كان فيلقًا لن يتردد ولو لعُشر ثانية في جلب الروبوتات إلى ساحة المعركة أو التضحية بحيوان على مذبح عدالة الخبراء، على المستوى التكتيكي سيكون ذلك من غير الأخلاقي إرسال فريق للخطر إذا كان من الممكن إجراء نفس العملية باستخدام الروبوت، وهو بالتأكيد لا يثير اهتمام معظم الخبراء لأنه من المحتمل أن أخطر شيء رأوه في حياتهم هو لوحة مفاتيح الكمبيوتر، هناك هو أيضا شك طفيف أن بعض الخبراء لديهم

كما أن النزعة المعادية للغرب هي التي تملي هذه الحملة وليس فقط الخوف من ظهور الأنظمة القتالية القائمة على الذكاء الاصطناعي،

ولن يكون من المستغرب أن يلبسوا إسرائيل وأنظمتها الدفاعية غطاء الاهتمام "الصادق" بالجنس البشري.

ورغم كل هذا فإنني لا أرفض كل ما يقولون، فنحن بالتأكيد بحاجة إلى سماع آراء مختلفة لأن هناك مخاطر يمكن فهمها حتى دون أن نكون خبراء.