نظرًا لأن التعلم من الأمثلة يتطلب قدرًا كبيرًا من قوة الحوسبة، فغالبًا ما يتم إجراؤه على أجهزة الكمبيوتر التي تحتوي على معالجات رسومات (GPUs) تتفوق في ذلك. ومع ذلك، فإن سرعة هذه المعالجات لا تزال منخفضة نسبيًا مقارنة بمعدل التعلم المطلوب للشبكات العصبية

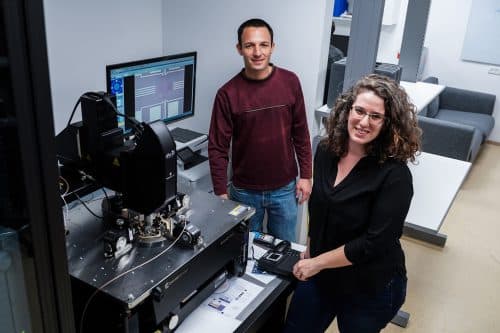

قام الباحثون في كلية فيتربي للهندسة الكهربائية في التخنيون بتطوير أجهزة مبتكرة تعمل على تسريع عملية التعلم لأنظمة الذكاء الاصطناعي. أدار البحث الدكتور شاهار كوتنسكي وطالبة الدكتوراه تسيفنات غرينبرغ-توليدو، وشارك فيه الطالبان روي مازور وأمير حاج علي. تم نشر مقالتهم في مجلة IEEE Transactions on Circuits and Systems التي نشرتها الجمعية الدولية لمهندسي الكهرباء والإلكترونيات (IEEE).

في السنوات الأخيرة، تم إحراز تقدم كبير في عالم الذكاء الاصطناعي، ويرجع ذلك أساسًا إلى نماذج الشبكات العصبية العميقة (DNNs). وتؤدي هذه الشبكات، التي تم تصميمها مستوحاة من الدماغ البشري وأساليب التعلم البشري، مهام معقدة بنجاح غير مسبوق مثل القيادة الذاتية، ومعالجة اللغة الطبيعية، والتعرف على العواطف في النص، والترجمة، والتعرف على الصور، وتطوير علاجات طبية مبتكرة. وذلك من خلال التعلم الذاتي من مجموعة ضخمة من الأمثلة - الصور على سبيل المثال. وتتطور هذه التكنولوجيا بسرعة في مجموعات البحث الأكاديمي، وكذلك في الشركات الضخمة مثل فيسبوك وجوجل، التي تسخرها لتلبية احتياجاتها.

نظرًا لأن التعلم من الأمثلة يتطلب قدرًا كبيرًا من قوة الحوسبة، فغالبًا ما يتم إجراؤه على أجهزة الكمبيوتر التي تحتوي على معالجات رسومات (GPUs) تتفوق في ذلك. ومع ذلك، فإن سرعة هذه المعالجات لا تزال منخفضة نسبيًا مقارنة بمعدل التعلم المطلوب للشبكات العصبية، لذلك لا يزال المعالج يمثل عنق الزجاجة في هذه العملية. علاوة على ذلك، فإن استخدام المعالجات يستهلك الكثير من الطاقة. وفقًا للدكتور كوتينسكي، "لدينا بالفعل أجهزة هنا كانت مخصصة في الأصل لاستخدامات أخرى - الرسومات بشكل أساسي - وهي لا تواكب الوتيرة السريعة للنشاط الذي يحدث في الشبكات العصبية. ولحل هذه المشكلة، نحتاج إلى أجهزة مخصصة تم تكييفها للعمل مع الشبكات العصبية العميقة."

وبالفعل، قام فريق بحث الدكتور كوتينسكي، على المستوى النظري، بتطوير أنظمة أجهزة تم تكييفها خصيصًا للعمل مع هذه الشبكات وتسمح للشبكة العصبية بأداء مرحلة التعلم بسرعة عالية وبطاقة منخفضة. وفقًا للدكتور كوتينسكي، "مقارنة بالعمل مع معالجات الرسومات، تعمل أجهزتنا على تحسين سرعة الحساب 1,000 مرة وتقليل استهلاك الطاقة بنسبة 80%."

تشكل الأجهزة التي طورتها المجموعة اختراقًا وتغييرًا مفاهيميًا حقيقيًا: بدلاً من تحسين المعالجات الموجودة، طور باحثو التخنيون هيكلًا لآلة حوسبة ثلاثية الأبعاد تدمج الذاكرة فيها. "بدلاً من التقسيم بين الوحدات التي تقوم بالحسابات والذاكرة المسؤولة عن حفظ المعلومات، نقوم بكل شيء داخل المرستور - وهو مكون ذاكرة ذو قوة حسابية يتم استخدامه في هذه الحالة خصيصًا للعمل مع الشبكات العصبية العميقة."

وعلى الرغم من أن هذا عمل نظري، فقد أثبتت المجموعة بالفعل تطبيق التطوير على مستوى المحاكاة. وفقًا للدكتور كوتينسكي، "تم تصميم تطويرنا للعمل مع خوارزمية التعلم "Momentum"، ولكن الهدف هو مواصلة تطوير الأجهزة بحيث تكون متوافقة أيضًا مع الخوارزميات الأخرى. من الممكن أنه بدلاً من العديد من مكونات الأجهزة المختلفة، سنقوم بتطوير أجهزة ديناميكية متعددة الأغراض يمكنها التكيف مع خوارزميات مختلفة.

تعليقات 4

هناك عدد لا بأس به من الشركات الناشئة، بما في ذلك الشركات الإسرائيلية، التي تعمل على تطوير أجهزة مخصصة لشبكات التعلم العميق. لديهم بالفعل الأجهزة في متناول اليد. يتحدثون أيضًا عن أرقام مماثلة لتحسين سرعة الحساب واستهلاك الطاقة. إذا ما الجديد؟ أنا على يقين تقريبًا من أن رجال التخنيون يعرفون هذا الأمر، لذا إذا كنت ستنشر على موقع العلوم، فليكن على المستوى المناسب من العمق...

كل الاحترام. هناك دراسات وهناك دراسات. هناك تطورات وهناك تطورات. هذا النظام على أعلى مستوى.

تمتلك Google منصة TPU لإجراء عمليات حسابية سريعة على الموترات (في جيلها الثالث الآن). هل التطوير في التخنيون أفضل من هذا؟

استنشق